※ 本文轉寄自 ptt.cc 更新時間: 2022-10-07 17:58:20

看板 C_Chat

作者 標題 [閒聊] 推特:防止AI學習繪師作品的方法

時間 Fri Oct 7 15:17:24 2022

就是在作品圖中加入人類肉眼難以辨識的雜訊

https://i.imgur.com/PBBbNRA.jpg

![[圖]](https://i.imgur.com/PBBbNRA.jpg)

https://twitter.com/Akihitweet/status/1577827240330809344?t=FOSz6UZh2oyMsStXJ8LE

Zg&s=19

不過回覆裡也有人說有技術可以克服雜訊問題就是了

延伸閱讀:如何欺騙AI

https://youtu.be/YXy6oX1iNoA

--

※ 發信站: 批踢踢實業坊(ptt.cc), 來自: 182.239.85.157 (香港)

※ 文章代碼(AID): #1ZFzA7bN (C_Chat)

※ 文章網址: https://www.ptt.cc/bbs/C_Chat/M.1665127047.A.957.html

推 : 如何欺騙人類1F 10/07 15:18

推 : 這真的比較是在欺負盜圖仔肉眼w2F 10/07 15:18

→ : 就只不過是在抓圖時候多一道刪除雜訊的步驟3F 10/07 15:19

→ : 就多一道工序而已== 哪有差4F 10/07 15:19

→ : 你不如整張圖都打上馬賽克還比較有用

→ : 你不如整張圖都打上馬賽克還比較有用

推 : 這是不是跟防b站盜片是同一個原理6F 10/07 15:19

→ : 這跟加浮水印一樣沒屁用吧,又不是不能去除掉7F 10/07 15:20

推 : 在色圖加入雜訊→古典制約導致性奮與雜訊連結→未來8F 10/07 15:20

→ : 光看雜訊就可以射

→ : 光看雜訊就可以射

推 : 這就上鎖的概念 總會有拆鎖專家10F 10/07 15:20

→ : 人眼不能辨別,但是AI勒?11F 10/07 15:21

→ : 但是上鎖可以防止很多低等ai也是事實12F 10/07 15:21

→ : 建議加上防支咒13F 10/07 15:21

推 : adversarial perturbation14F 10/07 15:21

→ : 人眼不能辨識=我可以正常尻 ai會辨識=ai會得到跟我們不一15F 10/07 15:22

→ : 樣的資訊 這樣有沒有看懂

→ : 樣的資訊 這樣有沒有看懂

→ : 實際上根本不同類型的AI 不會有什麼效果17F 10/07 15:22

→ : 跟以前看到鎖碼台雜訊畫面就勃起一樣18F 10/07 15:23

推 : AI看得懂=AI可以把它挑出來去掉 多一道工而已19F 10/07 15:23

推 : AI在讀樣本時不會做濾波嗎?20F 10/07 15:24

→ : 單張圖識別物件才有用21F 10/07 15:24

推 : 只有一招 那就是拒絕交流 但肯定不值得22F 10/07 15:25

推 : 有人覺得只有他看得懂欸 笑死23F 10/07 15:25

推 : 偷放維尼和綠色母狗呢24F 10/07 15:25

→ : 可以做到原圖相似度97%以上 但肉眼看不出來25F 10/07 15:25

→ : 早在讓AI畫圖前這類去雜訊的研究就已經做幾十年了26F 10/07 15:25

→ : 這史前論文我覺得已經解決了啦27F 10/07 15:26

→ : 以前gan紅的時候gradient adversarial 就一堆了28F 10/07 15:27

→ : 已知用火

→ : 已知用火

推 : 你各位知道為什麼中國轉貼的圖片很多品質差又有雜訊了31F 10/07 15:27

→ : 吧,那是為了防盜啦

→ : 吧,那是為了防盜啦

推 : 這只能防到很低階的model吧33F 10/07 15:27

→ : 以前怎麼防駭客 直接物理分隔系統不連網 同一招34F 10/07 15:27

推 : 達文西領先業界500年...35F 10/07 15:27

推 : 這個是辨識用的模型 跟生成用的模型罩門不一樣 辨識36F 10/07 15:28

→ : 模型可能因為加一點雜訊就認錯物體 但加了雜訊的熊貓

→ : 在生成模型一樣會產生加了雜訊的熊貓

→ : 模型可能因為加一點雜訊就認錯物體 但加了雜訊的熊貓

→ : 在生成模型一樣會產生加了雜訊的熊貓

![[圖]](https://i.imgur.com/VyHLRzbh.jpg)

推 : 這種東西換個model就沒屁用了40F 10/07 15:28

→ : 沒錯 最強的鎖就是連門都沒有41F 10/07 15:28

Diffusion Models for Adversarial Purification

Diffusion Models for Adversarial Purification ...

Diffusion Models for Adversarial Purification ...

→ : 生成有雜訊的熊貓又如何 人眼又看不到43F 10/07 15:28

→ : 其實你各位每次輸入的驗證碼就是在幫ai識別啦44F 10/07 15:29

→ : 生成模型上不知道有沒有用就是XD45F 10/07 15:29

→ : 而且那是影響分類問題 不知道對生成模型是有什麼影響46F 10/07 15:29

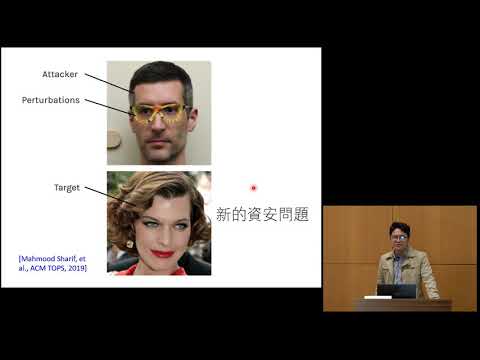

推 : 這個沒用啦 李弘毅前幾天在講transfer learning的時候才47F 10/07 15:29

→ : 講過這個,那裡的研究原因是訓練出來的AI模型要防盜,結

→ : 論卻是在肉眼看不出來的雜訊下,AI因為減少了Overfittin

→ : g反而效果更好

→ : 講過這個,那裡的研究原因是訓練出來的AI模型要防盜,結

→ : 論卻是在肉眼看不出來的雜訊下,AI因為減少了Overfittin

→ : g反而效果更好

→ : 這我好像十幾年前還在抓免空就聽過了51F 10/07 15:29

→ : 看著蠻搞笑的 已經不知道安怎了..52F 10/07 15:29

→ : 你攻擊gan可能還有點機會 但是現在紅的是diffusion53F 10/07 15:29

推 : SD本身就是建立在去噪的模型,這種防禦方式會有用嗎54F 10/07 15:30

→ : diffusion 就是在去雜訊的==55F 10/07 15:30

→ : GAN有分類器 擴散模型沒有56F 10/07 15:30

推 : Difussion好像就是用加雜訊去雜訊的方式訓練的,懷疑57F 10/07 15:31

→ : 這個方法有效性

→ : 這個方法有效性

→ : 建議可以先去看幾門開放式課程再來59F 10/07 15:33

→ : 繪師在這方面那比得過真正的工程師 耍小聰明哪有用60F 10/07 15:34

推 : 用AI的方法對抗AI? 腦洞真大,多一道工而已,連遊戲61F 10/07 15:34

→ : DRM 都擋不住駭客,你才圖片是要擋什麼

→ : DRM 都擋不住駭客,你才圖片是要擋什麼

→ : 這方法完全無效,不用幻想了63F 10/07 15:34

→ : 繪圖軟體也是程式來的64F 10/07 15:34

→ : 不要自以為能在技術上取巧 技術一年可能好幾次大改65F 10/07 15:34

→ : 你如果加了雜訊圖好看那train下去一樣會生出好看的東西66F 10/07 15:35

→ : 那就只好生出產生雜訊的AI了67F 10/07 15:36

→ : 這麼想防 那就是從現在開始都別放圖68F 10/07 15:36

→ : 工程師:已知用火69F 10/07 15:36

推 : 影像處理早就能搞定這種東西了70F 10/07 15:36

推 : 現在主流網站用可見雜訊驗證碼都防不住機器人了 影像辨71F 10/07 15:36

→ : 識很強大捏

→ : 識很強大捏

→ : 就算不改模型,也只是多一道工,而且除非全加了,不然總73F 10/07 15:36

→ : 有沒加工的

→ : 有沒加工的

→ : 加到整張看不清楚連粉絲都不想看的話,他們也懶得盜你圖75F 10/07 15:36

推 : 那個雜訊還原 已經....76F 10/07 15:37

→ : 對 最終就會走向大家都不放圖的境界77F 10/07 15:37

→ : 不放圖先餓死繪師而已78F 10/07 15:37

推 : Ai學老圖就夠本了吧…79F 10/07 15:38

推 : 這個AI本身就是以降噪為基底去練習的,這就像是在國文80F 10/07 15:38

→ : 考卷上丟一堆幼稚園數學題目,AI看了都會笑

→ : 考卷上丟一堆幼稚園數學題目,AI看了都會笑

→ : 訓練過程就會加噪了 等於是繪師先幫忙放了一點noise82F 10/07 15:38

→ : 這已經好幾年前的問題了 早就被解決了83F 10/07 15:38

→ : 看著跟當時抖音的情況有點像? 結果應該也差不多 使用84F 10/07 15:38

→ : 者越來越多的話

→ : 者越來越多的話

→ : 最後ai學ai誰要學繪師86F 10/07 15:39

推 : 真正厲害早就去當工程師了哪會繪師87F 10/07 15:39

推 : 但繪師的知名度和商業來源要先從分享開始 所以別想了88F 10/07 15:39

推 : 越來越好奇未來的發展了89F 10/07 15:39

→ : 工業革命時的手工業者最後還不是得進工廠工作90F 10/07 15:40

推 : 這套是騙分類器用的 aka tag污染91F 10/07 15:42

→ : 對於diffusion來說可以說是毫無作用w

→ : 對於diffusion來說可以說是毫無作用w

推 : AI現在生的圖的等級 其實已經告訴你這雜訊效果不大了93F 10/07 15:43

推 : 最後就會變成繪師都懶得畫圖 ACG二創市場萎縮 宅宅只94F 10/07 15:45

→ : 能看AI圖尻尻 大家互相傷害罷了

→ : 能看AI圖尻尻 大家互相傷害罷了

![[圖]](https://i.imgur.com/qMV2uoHh.jpg)

推 : 看以後會不會變成軍備競賽囉,我反制你的反制之類的98F 10/07 15:47

推 : 好像還滿多人樂見這種互相傷害 笑死 以後大家都沒得看99F 10/07 15:48

推 : 活不到那個以後啦 都沒得看是要發展成怎樣==100F 10/07 15:49

推 : 我倒覺得以後AI會變成繪師工作用IDE的一部份吧101F 10/07 15:49

→ : 說到底還不是要人下指令 修圖也還是繪師修的好

→ : 說到底還不是要人下指令 修圖也還是繪師修的好

推 : 不放圖就不能當社群偶像了 太苦了103F 10/07 15:51

→ : 是說有時間想這些有的沒的 不如趕快去研究AI可以怎樣讓

→ : 自己的產圖更多更好

→ : 是說有時間想這些有的沒的 不如趕快去研究AI可以怎樣讓

→ : 自己的產圖更多更好

推 : 這方法太低階了吧...106F 10/07 15:52

推 : 怎麼可能沒得看 如果AI圖夠好看夠有趣 大家看AI圖一樣享樂107F 10/07 15:52

→ : 如果AI圖千篇一律 沒故事性 那樣人類繪師就會繼續主流

→ : 如果AI圖千篇一律 沒故事性 那樣人類繪師就會繼續主流

→ : 這張圖是數位邏輯還是影像辨識課本跑出來的吧XD109F 10/07 15:53

→ : 這種程度應該很好分離出來

→ : 這種程度應該很好分離出來

推 : 真的要防就是完全斷網啦111F 10/07 15:53

推 : 真的要防就是畫完送碎紙機 不上傳不出版就不可能被學112F 10/07 15:56

推 : 都有對抗式訓練了 那比白噪點更能攻擊網路113F 10/07 15:56

噓 : 不就和驗證碼一樣,到後來正常人根本不知道驗證碼那團114F 10/07 15:56

→ : 歪七扭八文字是啥,但是電腦卻能辨識

→ : 歪七扭八文字是啥,但是電腦卻能辨識

推 : 只能讓自己推的愛心數變少而已116F 10/07 15:57

推 : 去防這個 不如公開模仿資訊讓繪師抽成117F 10/07 15:57

推 : 這超多人在做了吧118F 10/07 15:57

推 : 這老方法了 一堆外行仔zzz119F 10/07 15:58

推 : 騙分類器的老方法是有什麼用120F 10/07 16:00

→ : 畫師都死去大概也沒差 到後來用照片訓練 AI圖互相訓練121F 10/07 16:01

推 : 這就第N次工業革命阿 先學會用法的人可以把其他人淘汰掉122F 10/07 16:01

→ : 然後再由受眾的反應去決定訓練的反饋就好了123F 10/07 16:02

→ : 就像當時阿法狗一樣 進化到後來 人類的棋譜反而是累贅

→ : 就像當時阿法狗一樣 進化到後來 人類的棋譜反而是累贅

推 : 當AI已經能呈現出水準很高的圖 而不是什麼都畫成邪神125F 10/07 16:05

推 : 繪師本來就外行人啊 人家是畫圖的不是搞ai的是要多內行126F 10/07 16:05

推 : 文組想到的方法沒什麼參考意義127F 10/07 16:05

→ : 跟“人類”借圖還要知會一下 這個根本厲害 還難追溯源頭128F 10/07 16:06

→ : 表示它的理解能力已經不是這種雜訊就可以斷的了129F 10/07 16:07

推 : 這招是在瞧不起AI嗎130F 10/07 16:08

推 : 我的論文就是做這個的131F 10/07 16:10

→ : AI:哈欠。132F 10/07 16:17

→ : 想到網頁有時會出現,懷疑你是機器人。

→ : 想到網頁有時會出現,懷疑你是機器人。

推 : 就跟放符文防中國一樣啊 插入訊息防盜用134F 10/07 16:27

推 : 這一看就外行人的言論= =135F 10/07 16:29

→ : 晚點再回一篇好了 這篇只證明了懂AI真的很重要

推 : 之後繪師是不是應該要把李宏毅的課程列為必修阿

→ : 晚點再回一篇好了 這篇只證明了懂AI真的很重要

推 : 之後繪師是不是應該要把李宏毅的課程列為必修阿

推 : 不要上傳圖片讓它沒得吃138F 10/07 16:34

→ : 雖然現在的圖庫應該夠了

→ : 雖然現在的圖庫應該夠了

推 : 這個大概還是停留在剪貼時代的產物140F 10/07 16:35

推 : 一句話 來不及了啦141F 10/07 16:39

→ : 小干擾就死掉的AI不會被端出來啦142F 10/07 16:46

→ : 以為工程師的頭髮白掉的?

→ : 以為工程師的頭髮白掉的?

→ : 這麼怕就不要貼圖出來就好了==144F 10/07 16:49

→ : 這沒用...145F 10/07 17:04

推 : 前面加個濾波器就破解了146F 10/07 17:13

推 : 人類對ai做的事 就像以前大人為小孩裝了第四台鎖碼器147F 10/07 17:18

推 : 其實加雜訊進去 會讓這個程式更有robust 本來就有這個148F 10/07 17:24

→ : 技術了 這篇是在反串嗎XD

→ : 技術了 這篇是在反串嗎XD

推 : 笑死,真的是已知用火欸150F 10/07 17:24

噓 : 這個本來就有在研發不是?151F 10/07 17:30

推 : 那就是補一個filter再餵圖而已152F 10/07 17:36

推 : 訓練都會加noise了,你這個反而是幫助他們訓練,153F 10/07 17:44

--

※ 看板: ACG 文章推薦值: 0 目前人氣: 0 累積人氣: 304

作者 gundamx7812 的最新發文:

- 事源是自民黨在神奈川8區的候選人三谷英弘的政策小冊子插圖被指實在是太像 《逆轉裁判123》的封面。無論是構圖,人物姿勢甚至是男主的樣貌都十分相似。 (上:三谷英弘的宣傳;下:《逆轉裁判123成步堂精 …74F 50推 2噓

- 7F 3推

- 20F 16推

- 10F 4推 1噓

點此顯示更多發文記錄

回列表(←)

分享